A Google Research apresentou o VaultGemma, um modelo de linguagem com mil milhões de parâmetros, construído desde o início com privacidade diferencial (DP). Trata-se do modelo aberto mais avançado neste domínio, disponível no Hugging Face e no Kaggle.

Afinal, o que é a privacidade diferencial?

A privacidade diferencial é uma técnica matemática que adiciona ruído controlado durante o treino dos modelos, impedindo que memorizações individuais fiquem expostas. Isto garante que a IA não consegue revelar dados específicos dos utilizadores ou documentos usados no treino.

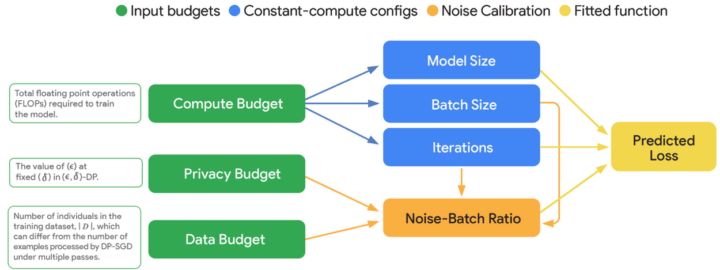

A Google estudou como equilibrar computação, tamanho de modelo, quantidade de dados e ruído para otimizar o treino. Ao contrário do treino tradicional, os modelos privados beneficiam de lotes muito maiores.

Segundo das revelações da Google, foi usado o método DP-SGD (Differentially Private Stochastic Gradient Descent) com avanços recentes que permitem eficiência e garantias de privacidade robustas.

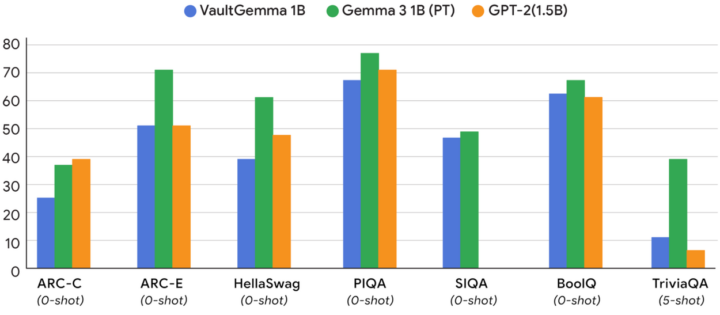

O VaultGemma aproxima-se do desempenho de modelos não-privados lançados há cerca de cinco anos, como o GPT-2.

Este lançamento representa um marco no desenvolvimento de IA responsável e segura, mostrando que é possível treinar modelos poderosos com proteção de dados incorporada desde a base.

A Google espera que a comunidade aproveite o VaultGemma para acelerar a próxima geração de aplicações de IA com privacidade como princípio fundamental.